Разложи ру дурак переводной: Дурак переводной - Мини-игры Mail.Ru

Дурак переводной на разложи ру

Описание Народной карточной игры Дурак варианты игры

Различные вариации карточной игры в дурака

Существует бесчисленное множество вариантов карточной игры в дурака, ниже приведены разновидности дурака, наиболее распространенные в народе.

Дурак-Трешка

Игра в «трешку» «дурака» отличается от игры в простого «дурака» тем, что каждый игрок обязан заходить сразу с 3-х карт, если осталось менее 3-х карт, то с 2-х карт, если нет 2-х, то с 1 карты.

Бескозырный дурак

Игра в безкозырного «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что игра идет без козырей.

Большой дурак

Игра в «большого дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что игра идет с 2 колодами карт.

Двухкозырной дурак

Игра в двухкозырного «дурака» отличается от других разновидностей игры в «дурака», тем, что каждый игрок играет со своим козырем. Причем козырная карта соперника не является козырем для игрока и он может побить ее своим козырем или же другой картой такой же масти, но большего значения. Во всем остальном игра ведется по правилам простого, подкидного или переводного «дурака».

Дорожный дурак

Одна из разновидностей данной игры. Сдают всю колоду поровну каждому игроку. Последнюю карту сдающий открывает и показывает: это — козырь. Он принадлежит сдающему. Первым ходит тот, кто имеет младший козырь или тот, кто выиграл в предыдущей партии. Он идет под игрока одной картой, которую нужно побить. После того, как карта побита игроку необходимо либо подкинуть (побить) уже верхнюю (побившую первую) карту, либо согласиться на отбой, тогда ход переходит к отбившемуся игроку.

Китайский дурак

Игра в китайского «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что первым ходит тот игрок, у которого 9 бубны. Если игрок отбился 9 бубны, то карты сразу падают в отбой, если игрок не отбился, то берет только первую карту, которую отбивал. Выигрывает тот, у кого не останется карт.

Козырной дурак

Игра в козырного «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что последняя карта с отбоя меняется с козырем и игра продолжается с новым козырем.

Королевский дурак

Игра в королевского «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что самую младшую карту можно отбить только тузом, причем козырным тузом можно отбить любую младшую карту.

Круговой дурак

Игра в кругового «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что после каждого отбоя или взятия карт, карты игрока и компьютера меняются между собой.

Магаданский дурак

Игра в магаданского «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что из 6 розданных карт игроку и компьютеру 5 карт недоступно для игры. С каждым отбоем открывается по 1 карте. Например, если отбился компьютер, то у него открывается 1 закрытая карта. Когда заканчивается колода с картами, то все недоступные карты открываются и ими можно играть.

Наваленный дурак

Игра в наваленного «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что колода карт раздается за один раз. Игроку имеющему младший козырь дается право первого хода. Далее игра ведется по правилам соответственно простого, подкидного или переводного «дурака».

Игроку имеющему младший козырь дается право первого хода. Далее игра ведется по правилам соответственно простого, подкидного или переводного «дурака».

Верю не верю

Игра «Верю не верю» отличается от игры в простого, подкидного или переводного «дурака» следующим. Каждый игрок может отбиваться втемную для другого игрока, как правильно, так и неправильно. Причем другому игроку предлагается проверить правильность отбоя. Если при вскрытии карты обнаруживается, что компьютер отбился правильно, то забирает карты игрок, если компьютер отбился неправильно, то карты забирает компьютер. Пример игры: допустим, игрок зашел с 6 крести, компьютер отбивается 8 крести, далее игрок подбрасывает 8 пики, компьютер отбивается 7 пики, положив карту рубашкой вверх, так что игрок не знает какой картой отбился компьютер. Если игрок соглашается с данным отбоем, то карты идут в отбой, если нет, то карта 7 пики открывается и компьютер забирает карты себе, так как неправильно побился, если бы компьютер отбился правильно, то карты забрал бы себе игрок, так как не согласился с отбоем.

Невидимый дурак

Игра в невидимого «дурака» отличается от других разновидностей игры в «дурака», тем, что каждый игрок знает масть козырной карты, но не видит самой карты до конца игры, пока в колоде не останется 1 карта. Во всем остальном игра ведется по правилам простого, подкидного или переводного «дурака».

Оборотный дурак

Шуточная разновидность игры в «дурака», совершенно нераспространённая игра. Игра ведётся по правилам простого, подкидного или переводного «дурака», но с той лишь разницей, что игроки держат карты рубашкой к себе, а лицевой стороной к партнёрам. Игроки не смотрят своих карт ни при раздаче, ни при доборе. Игрок, неверно побивший, переведший или подкинувший карту, забирает все карты хода.

Отбойный дурак

Игра в отбойного «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что каждый второй отбой отбиваемые карты идут не в отбой, а в колоду с картами, где они перемешиваются с другими картами и после докладываются игроку или компьютеру.

Очковый дурак

Игра в очкового «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что побеждает тот, кто отобьет большее количество карт соперника.

Простой дурак

Карточная игра, распространённая в России в XIX веке. Не признаваемая высшим светом, эта игра в дурака пользовалась большой популярностью в простонародье. В настоящее время почти не встречается и, по крайней мере, сильно уступает в популярности Дураку подкидному и Дураку переводному.

Ходить можно либо с одной карты любого достоинства, либо с 2-х карт одного достоинства.

Ходить можно либо с одной карты любого достоинства, либо с 2-х карт одного достоинства.Игрок, под которого сделан ход, должен покрыть (побить) все карты, которыми сделан ход. Если он не может покрыть хотя бы одной карты, он обязан взять (принять) все карты, которыми сделан ход. Следующий ход в этом случае принадлежит игроку ходившему. Если же игрок покрыл все карты, то нельзя подбрасывать новых карт и все карты со стола отправляются в отбой, чтобы больше уже не принимать участия в игре, а следующий ход принадлежит отбившемуся игроку.

После каждого отбоя или принятия карт, игроки по очереди добирают карты из колоды до 6. Очерёдность добора — сначала ходивший, потом отбивавшийся. Игроки добирают карты до тех пор, пока не будет разобрана вся колода, включая вскрытый козырь.

Количество карт, которыми сделан ход, не должно быть больше, чем количество карт на руках у игрока, под которого этот ход сделан. Смысл игры заключается в том, чтобы избавиться от всех карт на руках. Имеющий карты на руках, когда другой игрок избавился от всех своих карт и когда карты в колоде кончились, проиграл.

Занудный дурак

Игра в занудного «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что игрок может походить только с карты максимального значения, то есть если есть тузы, то с тузов, если есть короли, то с королей, если есть дамы, то с дам и т.д.

Пустой дурак

Игра в пустого «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что игрок берет карты из колоды только тогда, когда карты у игрока заканчиваются.

Албанский дурак

Игра в албанского «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что карты в колоде разложены по убыванию значений. То есть сверху колоды лежат тузы, далее короли, дамы, валеты и т.д.

Погонный дурак

Игра в погонного «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что побеждает тот, кто сделает большее количество погон сопернику. Причем в том случае, если количество поставленных погон будет одинаковым, то побеждает тот, кто поставит более старшие погоны. Погоном называется ситуация когда соперник берет 2 одинаковые карты по значению, причем только две, но не 3 или 4 карты.

Причем в том случае, если количество поставленных погон будет одинаковым, то побеждает тот, кто поставит более старшие погоны. Погоном называется ситуация когда соперник берет 2 одинаковые карты по значению, причем только две, но не 3 или 4 карты.

Покерный дурак

Игра в покерного «дурака» отличается от игры в простого, подкидного или переводного «дурака» тем, что игрок перед тем, как побить карту соперника имеет право поменять любые 2 карты с колоды, но только лишь в том случае, если у него не более 6 карт.

Чешский дурак

Русское название популярной европейской игры «мау-мау», получившей значительное распространение в России в середине XX века. Игра существует во множестве вариантов под разными названиями: «дурак английский», «фараон», «пентагон», отличающихся незначительными деталями.

Простой вариант карточной игры в Чешского дурака

Играют колодой карт в 36 карт. Сдаются карты по одной за раз, а всего по 5 каждому игроку.

Некоторые карты требуют после себя определённых действий – от следующего игрока:

6 – взять из колоды 2 карты и пропустить ход,

7 – взять из колоды 1 карту и пропустить ход,

Туз – пропустить ход,

Дама является козырем. Она может быть положена на любую карту. Игрок, выложивший даму, может заказать любую масть. Следующий игрок, в этом случае, может положить карту только заказанной масти или даму (и заказать любую масть).

Цель игры заключается в том, чтобы избавиться от всех карт на руках. Выигрывает первый, избавившийся от карт на руках. Проигравший считает очки на картах, оставшихся у него на руках.

Расчет очков

2 очка – Валет,

3 очка – Дама,

4 очка – Король,

11 очков — Туз,

Остальные карты – по достоинству.

Игрок, оставшийся с одной дамой на руках, проигрывает 20 очков.

Разновидности игры Чешский дурак

Вариант 1. При отсутствии требуемой карты игрок берёт из талона только одну карту, а если и она не позволяет сделать ход, то игрок пропускает ход.

Вариант 2. При игре малой колодой (32 листа) семёрка требует подъёма двух карт, восьмёрка – одной карты.

Вариант 3. Сдают по шесть карт. Сдающий открывает последнюю карту (которая идёт ему). Это его ход. Преимущественное значение имеет не дама, а валет. Оставшийся с валетом проигрывает сразу.

Вариант 4. «Дурак английский». Игрок, положивший туза, имеет право положить ещё одну карту той же масти и заказать масть следующего хода (отличную от масти туза). Если у владельца туза нет карты той же масти, он должен брать из колоды одну карту, а если и она не позволяет сделать ход, он теряет право хода и право заказать масть. Это право приобретает следующий игрок, если он положит на туза карту той же масти, что и туз или другого туза.

Если у владельца туза нет карты той же масти, он должен брать из колоды одну карту, а если и она не позволяет сделать ход, он теряет право хода и право заказать масть. Это право приобретает следующий игрок, если он положит на туза карту той же масти, что и туз или другого туза.

Вариант 5. «Фараон». Сдаётся по 4 карты. Если игрок заканчивает дамой, то он списывает со своих очков 30. Если дама – единственная оставшаяся на руках карта, записывает 30 штрафных очков.

Вариант 6. «Пентагон». Карты кладутся только в масть. Положить карту того же достоинства можно только в том случае, если лежит шестёрка. После заказа масти посредством дамы следующий игрок пропускает ход. Очки: Туз – 11, Король – 4, Дама – 20, Валет – 2, 10 – 10. За другие карты очки не начисляются.

Вариант 7. «Крокодил». Игра идет по правилам первого варианта, к которому добавляется следующее правило — король червей обязывает следующего игрока пропустить ход и взять 5 карт из колоды.

Чукотский дурак

Игра в чукотского «дурака» отличается от других разновидностей игры в «дурака», тем, что каждому из игроков раздается по 6 карт, колода с козырем удаляется из игры, а далее игра идет по правилам простого, подкидного или переводного «дурака».

Армянский дурак

Игра в армянского «дурака» отличается от игры в простого, подкидного или переводного «дурака» только тем, что игрок может зайти не только со своих карт, но и с карты лежащей поверх всей колоды.

Японский дурак

Правила игры в японского «дурака» отличаются от правил игры в простого, подкидного, переводного «дурака», только тем, что козыри всегда бубны, а пики бьются только пиками.

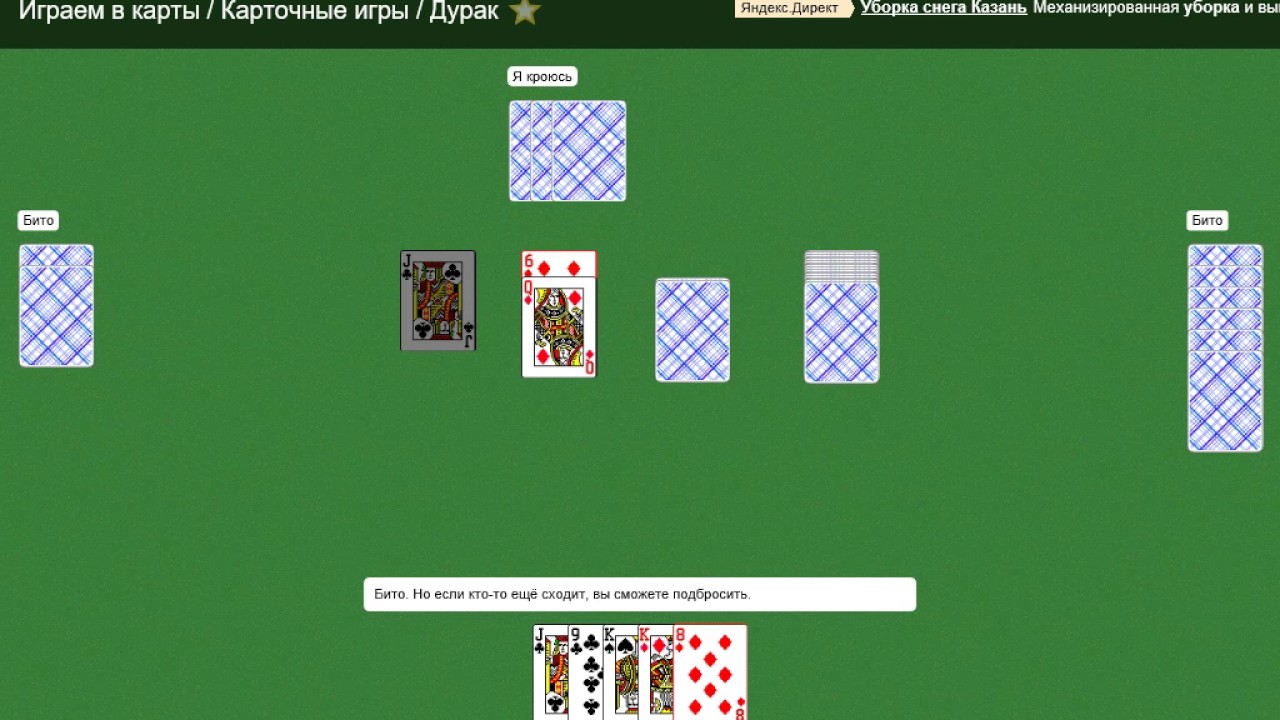

Компьютерная игра в дурака

Существует отличная программа для ПК — Карточная игра в дурака. разработанная Конюховым Александром. Она включает в себя около 40 известных вариатов этой народно карточной игры.

Особенно популярна была версия игры в дурака 4 1, на сегодня последняя версия этой карточной игры в дурака 6 2, а скачать свежую игру в дурака лучше всего на сайте производителя.

Дурак переводной разложи ру

Игра в КартыИгра в Карты онлайн через интернет хороший способ отвлечься от работы. История карт насчитывает уже сотни лет. Карты в играх делятся на группы: начиная с двоек, шестерок и заканчивая валетами, дамами, королями и тузами. Такой строй очень напоминает нашу жизнь.

История карт насчитывает уже сотни лет. Карты в играх делятся на группы: начиная с двоек, шестерок и заканчивая валетами, дамами, королями и тузами. Такой строй очень напоминает нашу жизнь.

Пасьянс Косынка

По правилам пасьянса нужно разложить карты по мастям начиная с туза, короля и тд. в четыре стопки.

Пасьянс паук

Играть в Пасьянс с возможностью выбора уровня сложности. Можно с друзьями провести соревнование через рейтинговую таблицу.

Солитер

Игра Солитер порадует вас хорошей картинкой и увлекательный геймплеем. Замечательная игра родом из детства.

Паук

Карточный Паук — игра классическая. Для победы разложите карты в одну стопку от валета до короля и туза.

Дурак подкидной

Что может быть проще, чем оставить в дураках Винни Пуха и его друзей. Понятные правила игры и увлекательный процесс никого не оставят равнодушными.

Червы

Игра в Червы родом из девяностых годов — надежный и проверенный способ убить время, как во времена когда ещё не было интернета так и по сей день.

Дурак переводной

Переводной Дурак игра в которую можно играть втроем или вчетвером. Главная особенность — это перевод хода на противника.

Косынка

Если вы хотите поиграть в Пасьянс — то обязательно начните с Косынки. Самая классическая и самая простая игра из всех Пасьянсов.

Пасьянс Солитер

В этой игре вы будете раскладывать пики по стопкам под звуковое сопровождение. Один ход отнимает минус 10 очков. Игра учит умению быстро считать.

Собери колоду

Собери колоду карт в одну стопку. Это не Пасьянс и не Паук, но очень на них похожа. Попробуйте, вам понравится.

Попробуйте, вам понравится.

Маджонг Солитер

Четыре туза и короля окружены разномастными картами. Вы выиграете когда соберете все карты в колоды по центру.

Маджонг

Если вы были в Китае и не играли в Маджонг — считайте, что вы там не были. Известнейшая настольная китайская игра в фишки.

Маджонг Артефакт

Маджонг Артефакты младший брат игры Mahjong. Подсказки и упрощенные правила позволят вам быстрее одержать победу.

Пасьянс Пирамида

Если вы сильны в арифметики то сможете с легкостью разобрать пирамиду, игра с математическим уклоном.

Маджонг Коннект

MahJong в самой сложной его интерпретации. Победить вам будет не просто. Собрать по парам фишки смогут не все. Начинать нужно с верхнего ряда.

© 2015 Игра в карты онлайн бесплатно, копирование материалов без активной гиперрсылки на сайт Igra-Karty.ru запрещено!

Игры соц сетей | Мои онлайн игры

В ВК мертвый штиль уже неделю в плане выхода новых игр, так что я залез на сайт espritgames, портала, откуда портируется в вк много азиатских поделок, на предмет узнать, а вообще-то хоть что-то выходит? И таки да, конвейер еспиритов не сломался, более того, запущена даже вполне занятная игра под названием стальное братство, которая наверняка скоро придет и в вк. Несмотря на то, что основа игры все тот же демон слеер, но все же в данном проекте реализовано немало любопытных ходов.

Несмотря на то, что основа игры все тот же демон слеер, но все же в данном проекте реализовано немало любопытных ходов.

Обзор игры стальное братство

Главная фишка игры в том. что вместо поднадоевшего сэттинга героического фэнтези используется сэттинг второй мировой войны, правда, с очень и очень вольной трактовкой. То есть здесь наш главный герой, в моем случае это типок с шестиствольным пулеметом, преследует в цепочке миссий Гитлера, а помогает ему в этом Альберт Эйнштейн и грудастые аниме красотки.

Ну то есть вы понимаете да, что серьезно такое ввести невозможно, поэтому в игре есть немало юмористических моментов, ну таких вот, забавных, но не смешных, но вроде нигде палку не перегнули.

Сама же игра строится по классическому канону игр типа легион мертвых, то есть изначально мы являемся одиноким героем и берем задания в городе. Затем телепортируемся на карту миссий, которые нам нужно пройти. В миссиях мы встречаем различных противников, которых убиваем. Вскоре нам одному уже тяжело и формируем команду наемников, в моем случае это штурмовик (броня, неплохой одиночный урон), пулеметчик (средняя броня, урон по площади) и снайпер (боец заднего ряда с высоким уроном, но слабой защитой). При этом у персонажей есть еще уникальные навыки, штурмовик можем выставлять тяжелый щит, гасящий урон противника, снайпер кидается гранатами и так далее. Но активируемых игроком навыков нет, все происходит в виде мультика, пр наличии вип можно даже просто пропустить весь бой.

При этом у персонажей есть еще уникальные навыки, штурмовик можем выставлять тяжелый щит, гасящий урон противника, снайпер кидается гранатами и так далее. Но активируемых игроком навыков нет, все происходит в виде мультика, пр наличии вип можно даже просто пропустить весь бой.

Объективно же, если сравнить легион мертвых и стальное братство, то в механике никаких принципиальных изменений нет, просто даже герои воины перестали бегать, а все стоят и стреляют.

Задания и подземелья.

Прикольно, что помимо боевых заданий есть дополнительные миссии, которые являются мини аркадками. Типа увернись от падающих с потолка болтов, но собери аптечки, или собери 5 деталей в нужной последовательности, из 10 карта выбирай дубли, и так далее. Ну то есть разработчики очень щедры на свой труд, вводят проходной и ни к чему не обязывающей мини игрушкой то, что иные выдают за полноценную игру, которую нужно покупать за отдельную плату.

Но большинство заданий все-таки боевые, нужно убивать супротивников десятками и сотнями. Есть одиночные бои, есть подземелья с 9 комнатами, которые надо зачистить от фашистской нечисти, есть групповые подземелья, элитные уровни на получение разных чертежей, монет и прочего.

Есть одиночные бои, есть подземелья с 9 комнатами, которые надо зачистить от фашистской нечисти, есть групповые подземелья, элитные уровни на получение разных чертежей, монет и прочего.

Развитие персонажей.

Ну опять всего богато, до легкой путаницы в очередной безумстве акций, опций, вариантов улучшений параметров для общей боеспособности. Большинство акций банальны — ежедневный вход, награда за онлайн, рулетка, акции сервера на скорейший набор уровней, например, какие-то фонды роста и ежедневные пополнения… Короче, все для того, чтобы вкладывали деньги и проводили в игре несколько часов в день. Из интересного только база, типа города в ДС, но с малым количеством зданий, и траление — поле, в котором нужно угадать, в каких ячейках награда, а где мина.

Для развития героев, поднятия мощи перса также всего много, причем если обычно с порога все упирается в кузницу, где надо улучшать экипировку, то здесь усиление шмота, заточки, открываются только на 29 уровней, то есть не слишком быстро. Зато крафт намного раньше, можно синтезировать из слабых вещей и запчастей с подземелий более сильные вещи. Ну то есть из синего ствола можно сделать фиолетовый, кому так понятней.

Зато крафт намного раньше, можно синтезировать из слабых вещей и запчастей с подземелий более сильные вещи. Ну то есть из синего ствола можно сделать фиолетовый, кому так понятней.

Также для улучшения доступны то, что дает бонус к характеристикам — воинское звание (банально), техника (навыки на всю команду), таланты (при получении воинских званий можно распределять таланты, дающие пассивные бонусы, например, снижение вражеского урона на 10%), военная машина (полный аналог скакунов из кучи таких игр).

Единственное, что занятно — это карточки. Выполняя в заданиях определенные условия, мы получаем карточки из колоды карт, там всякие 5 треф, бубновые дамы и другое. Наша задача собрать полную колоду карт с двойками и джокерами и получить максимальный бонус к характеристикам.

Также есть мутная тема с гранатой, которую также можно улучшать, повышая боевую мощь, но для этого нужно сидеть в шахте.

Итог, отзыв

В основе банальная командная ММОРПГ, но все же интересная попытка подать старое и надоевшее блюдо с новым соусом, то есть заменить фэнтези тематику на милитари второй мировой, причем это не в первый раз такая замена, просто в конкретно мморпг впервые. К тому же в игре есть несколько занятных находок, мини аркадки опять же любопытные. В общем, если бы я ставил оценки, то дал бы игре 4 с минусом.

К тому же в игре есть несколько занятных находок, мини аркадки опять же любопытные. В общем, если бы я ставил оценки, то дал бы игре 4 с минусом.

Дурак. Вариант правил «Переводной». — PDF Free Download

Chinese Checkers (Китайские шашки).

Шахматы 7 в 1 1. Девять мужчин Морис 2. Китайский шашки 3. Игральные карты 4. Домино 5. Шашки 6. Шахматы 7. Лудо Внимание! В комплектацию данной игрушки входят мелкие части. Для детей старше 3-х лет. Chinese

Подробнееלהנות מעולמות החשיבה והצורות!!!

להנות מעולמות החשיבה והצורות!!! טריפליקה חוקי המשחק משחק קלפים ל 2-5 שחקנים המכיל 3 אפשרויות משחק מהנות. המשחק משלב אסטרטגיה, זיכרון ומזל. במשחק 2 סוגי קלפים: קלפי מטרה קלפים אדומים — על כל קלף צורה אחת,

המשחק משלב אסטרטגיה, זיכרון ומזל. במשחק 2 סוגי קלפים: קלפי מטרה קלפים אדומים — על כל קלף צורה אחת,

ENTERPRISES INC. ПРАВИЛА ИГРЫ

ENTERPRISES INC. ПРАВИЛА ИГРЫ 7 Узнайте, всё ли в порядке с ВАШЕЙ кармой, в этой увлекательной динамичной игре! Вам необходимо избавиться от всех своих карт, но главное не оказаться последним! Последний

ПодробнееНастольная игра Зельеварение. Практикум

Настольная игра Зельеварение. Практикум Правила игры Урок Зельеварения начинается. Лучшую оценку получит тот из учеников Школы Чародеев и Магов, кто создаст наибольшее количество волшебных эликсиров и

Подробнее«Одиссея» автор: Антон Мурыскин

«Одиссея» автор: Антон Мурыскин — от 10 лет — от 2 до 4 игроков — 30 минут «Одиссея» карточная мини-игра автор: Антон Мурыскин (muryskin@gmail. com) Одиссея это карточная игра для 2-4 игроков от 10 лет.

com) Одиссея это карточная игра для 2-4 игроков от 10 лет.

На Арбате Правила игры 2 игрока, 30 минут

На Арбате Правила игры 2 игрока, 30 минут Вечерняя жизнь на Арбате кипит. И всегда в гуще событий местный алкаш и красотка, гармонист и певица. Чтобы ничего не пропустить, народ тянется туда, где они.

ПодробнееR E I N E R K N I Z I A

R EINER K NIZIA Карта разделена на 12 областей, каждую из которых игроки посетят только один раз. В каждой области игроки будут конкурировать друг с другом, используя свои карты влияния. Каждое посещение

ПодробнееОсновные правила игры в преферанс

Основные правила игры в преферанс Колода карт для игры в преферанс Преферансная колода состоит из 32 карт. В ней 4 масти по 8 карт в каждой — от туза до семерки. Старшинство мастей по возрастанию: пики,

Старшинство мастей по возрастанию: пики,

Настольная игра «DOG Royal», арт 49267

Настольная игра «DOG Royal», арт 49267 Увлекательная командная игра Иоганна Шмидауэр-Кёнига для 2-6 игроков ВНИМАНИЕ: Если вы еще не знакомы со стандартной игрой DOG (артикул 49201), мы рекомендуем сначала

ПодробнееОПИСАНИЕ ИГРЫ. Реликвии

В Индии обнаружены два храма-близнеца, посвящённых давно забытым божествам Ананте и Гаруде. Говорят, источником их могущественной силы были загадочные реликвии, спрятанные в тайниках вокруг этих храмов.

ПодробнееОсновные правила игры в Блэкджэк

Основные правила игры в Блэкджэк «Blackjack» — это всем известная карточная игра «двадцать одно» или «очко». Правда, со временем игра была серьёзно видоизменена. Была разработана научная теория, применение

ПодробнееОбщие сведения. Игровые сущности

Общие сведения Эадор разбитый на осколки мир, за власть над которым могут сразиться от 2 до 6 игроков. Захват мира обычно продолжается 25 50 минут. Игровые сущности Карты владык 6 штук. Владыки помогают

ПодробнееЦель игры. Компоненты игры

Игра Антуана Боза Иллюстрации Жераля Герле Для — игроков От 8 лет Компоненты игры Правила игры 0 игровых карт 8 синих жетонов красных жетона разноцветных карт для дополнения «Шквал цветов». Примечание.

ПодробнееСправочник Фруктогонщиков

Справочник Фруктогонщиков В этом справочнике содержится описание всех 59 карт животных и их действий. Перед началом первой игры игрокам нужно знать правила только для первых шести карт животных. Остальные

Подробнее1. КАРТОЧНАЯ ИГРА «РУССКИЙ ПОКЕР»

1. КАРТОЧНАЯ ИГРА «РУССКИЙ ПОКЕР» 1.1. Цель игры — собрать покерную комбинацию, которая будет выше, чем у дилера казино, а так же получить максимально возможную выплату, используя предлагаемые в игре правила.

ПодробнееКомплектация игры: Цель игры

ПРАВИЛА Время острова Твист истекает! Одна за другой на остров обрушиваются катастрофы и метеоритные дожди. Только самые сильные динозавры смогут спастись на соседних островах! от 7 лет 2-6 чел. от 15

ПодробнееО чем игра. Компоненты. Термины

О чем игра Игра «Локалка» карточная ролевая игра про ИТ-специалистов, которые противостоят друг другу в борьбе за информацию в локальной сети. Каждый участник игры отыгрывает роль ИТ-специалиста. Вначале

ПодробнееÖåëü èãðû. Ïîäãîòîâêà ê èãðå

8 паромов Наводнение началось. Пришло время собирать животных на борт паромов, направляющихся к ожидающему неподалеку Великому Ковчегу. Но задача эта не из простых, так как каждый паром имеет ограниченную

ПодробнееНастольная игра Зельеварение. Практикум

Настольная игра Зельеварение. Практикум Правила игры Урок Зельеварения начинается. Лучшую оценку получит тот из учеников Школы Чародеев и Магов, кто создаст наибольшее количество волшебных эликсиров и

Подробнее+/- и 3 подставки под карты.

RU 2-5 игроков от 8 лет — продолжительность игры: 15-20 минут СОСТАВ ИГРЫ 63 пронумерованные карты, на которых изображены от нуля до трёх символов песочных часов: 25 Красных карт с числами от 1 до 25,

ПодробнееПравила игры в техасский покер

Правила игры в техасский покер Шаг 1. Некоторые основные правила техасского покера. Техасский покер играется стандартной 52-карточной колодой. Отличительная особенность заключается в использовании пяти

ПодробнееЦель игры. Комплектация игры

Правила игры 1 Представьте, что на заре времен вы готовитесь создать новый мир. Вы наделены силой стихий и безграничным вообра жением. Но как только вы создали первые горы и населили живыми существами

ПодробнееМЕТОДИЧЕСКОЕ ПОСОБИЕ

МЕТОДИЧЕСКОЕ ПОСОБИЕ Дорогие друзья, предлагаем вашему вниманию игру «Калейдоскоп букв»! Эта игра разработана для тренировки навыков, важных для качественных чтения и письма. При неимоверной полезности

ПодробнееПравила игры в «Маджонг»

Правила игры в «Маджонг» Маджонг это китайская игра, в которой участвуют 4 игрока. Цель данной игры собрать комбинации и также получить за них высокие очки. Чтобы достигнуть победы, каждый игрок получает

ПодробнееПРАВИЛА ИГРЫ ЦЕЛЬ ИГРЫ

Черепаха приняла вызов зайца на матч-реванш, и эта новость распространилась по всей округе. Большая гонка вот-вот начнется, и все участники готовы к решающему сражению. Кто из животных, заяц, черепаха,

Подробнеенастольная карточная игра БланкА ПРАВИЛА

настольная карточная игра БланкА ПРАВИЛА Увлекательная веселая игра и популярное времяпровождение в кругу друзей и семьи. БЛАНКА — это забавное развлечение и серьезное размышление. Отличное средство тренировки

ПодробнееИграть в игру чемпионат по переводному дураку

Тут новая игра вышла, которая заставила меня немного понастольгировать по временам моего детства, когда игры в карты были одним из главных развлечений, так как шахматы требовали много времени, усидчивости и вообще не для всех, в тоже время как картишки доступны самому последнему дураку, тем паче в того самого дурака научиться может играть также любой.

И да, из любопытства в поиске приложенй ввел слово дурак, и так-таки да — 22 игры и сборки игр предлагают сыграть в игру дурак, так что выбор очень большой, на любой вкус, с разными вариациями, графикой и примочками.

И это забавно, потому что ведь есть уже масса альтернативных классных настольных игр, например, тот же манчкин шикарен для компании, или вот игра Гномы-вредители доступна для покупки, ан нет, люди все равно плотно зависают в дурака, еще и на компе в него играют онлайн, что вообще.

Обзор игры переводной дурак: чемпионат.

Особенность данной игры в том, что она продолжает традицию игры Подкидной дурак: чемпионат, только механика игры переместилась в сторону переводного, где можно переводить колоду на соседа, если есть такая же карта на руке, как сходили на тебя. Никогда не любил переводного, потому что вводит слишком много хаоса по своему, разрушает логику, но кому как.

Если говорить непосредственно по игре, то здесь все просто — у вас 6 карт на руке, рядом со столом лежит колода, на которой обозначается козырная карта, чья масть считается самой старшей.

Ходит тот первый, у кого на руках самый младший козырь. При этом если в реальном дураке нужно отслеживать карты, у кого сколько и чего, то здесь все происходит автоматически, убрав все спорные моменты.

Кладем карту игроку напротив, если у него есть такая же карта (ну то есть по цифре или значению одинаковая, не по масти), то он может перевести ее соседу, а если и у соседа есть такая же карта, то вообще может ваш заход вернуться к вам же и придется крыть. Если такой же карты нет, то нужно крыть старшей картой такой же масти. Ну то есть шестерку треф можно покрыть любой картой треф, но вот короля можно победить только тузом.

Карты козырной масти бьют все остальные масти. В общем, самая главная карта в игре — козырный туз, если ее вам кинули, то не покрыть, все остальное можно отбить в теории, но на практике…

На практике могут накидать карт, которые нечем покрыть и без козырного туза, так что колода на руке может раздуться до больших размеров. Но в этом есть и свой плюс, так как дает нам возможности для маневра — мы имеем карты для того, чтобы подбросить их в ответственный момент, и нам обычно есть чем крыть. Правда, все равно чем больше карт на руке, тем меньше шансов выиграть, так как побеждает тот, у кого кончились карты на руке. Выигравший забирает банк, виртуальные монеты, которые служат ставкой в игре. Правда, при выигрыше получаем всего 15к при ставке в 10к, как-то деньги все равно кончатся, если вы не мега крутой и везучий картежник.

Деньги на ставки можно получить за рубли, или с определенными интервалами даются в игре, типа ежедневные, подарки от друзей, бонусы.

Также можно поучаствовать в чемпионате, здесь нужно провести целую серию игр, и в итоге тот, кто выиграл серию, получает весь банк. С ростом уровней открываются новые чемпионаты.

Что-то я окончательно убедился, что не очень люблю карточные игры такого типа. Нет, пасьянсы разложить ок, в манчкина сыграть — да с удовольствием, а вот рандомная псевдо-интеллектуальная игра, которой увлекались миллионы, да и сейчас многие еще играют, все-таки неее. Ну то есть полчаса ностальгии с интересом, потом уже не хочется.

Обзоры на похожие игры:

Карты дурак переводной разложи

Уважаемый пользователь, вы зашли с устройства под управлением Android.

Предлагаем вам игры, приложения и сайты, разработанные специально для вашего устройства!

Короткие Нарды на iOS и Android! Играйте бесплатно! 4 000 000 игроков!

Развивайте стратегическое мышление!

Оттачивайте тактические приемы!

Сражайтесь с реальными соперниками!

Получайте бесплатные фишки каждый день!

Единое игровое пространство с порталами Мини-игры Mail, Мой Мир и Одноклассники

Играйте бесплатно в Длинные Нарды на iOS и Android вместе с 7 000 000 игроков!

Бесплатные фишки каждый день!

Система достижений и наград

Тысячи игроков онлайн всегда!

Миллионы фишек в мини-игре Hi-Lo!

Единое игровое пространство с длинными нардами на порталах Мини-игры Mail, Мой Мир и Одноклассники

Играйте в захватывающие игры, общайтесь с друзьями, вступайте в группы, смотрите кино! Все это теперь можно делать прямо на ходу!

Обзор Poker Arena на Hi-Tech Mail

Любите играть в покер. Скорее читайте, почему Poker Arena лучше других игр!

Супер увлекательный техасский холдем покер! Берите карты и выигрывайте! Тысячи игроков круглосуточно!

Другие бесплатные игрыПохожие игры

-

Уважаемый пользователь, вы зашли с устройства под управлением Android. Предлагаем вам игры, приложения и сайты, разработанные специально для вашего устройства! Короткие Нарды на iOS и Android!…

-

Уважаемый пользователь, вы зашли с устройства под управлением Android. Предлагаем вам игры, приложения и сайты, разработанные специально для вашего устройства! Короткие Нарды на iOS и Android!…

-

Уважаемый пользователь, вы зашли с устройства под управлением Android. Предлагаем вам игры, приложения и сайты, разработанные специально для вашего устройства! Короткие Нарды на iOS и Android!…

-

Играть 1000 (Игра Тысяча) Интриги при монарших дворах, брачные союзы между правящими династиями, борьба за право обладания короной Все мы знакомы с королевской жизнью лишь по историческим…

-

Долгожданный запуск «Чемпионата по Переводному Дураку» — для всех кому уже понравился «Чемпионат по Подкидному». Пройдите турнирную карьеру в самой популярной русской карточной игре по городам…

Как научиться хорошо играть в дурака. Тактика игры в карты. Общие правила игры «Дурак» в карты

Карточная игра в «Дурака» — одна из самых известных и любимых в стране. Количество игроков ограничено лишь количеством карт. Как правило, чем участников больше, тем веселее играется.

В «Дурака» не принято играть на деньги, это дурной тон. Но на желания и забавные фанты играют с удовольствием. Нежелание кукарекать под столом или прилюдно петь смешные песни — отличный стимул для победы. Игроки, чтобы не стать «дурачками», готовы побеждать даже нечестным путем. Как мухлевать в «Дурака», чтобы другим не было обидно? В статье приводятся нехитрые секреты и стратегия игры.

Как научиться мухлевать в «Дурака»

Для любого обмана, даже самого незначительного, требуются стальные нервы и умение держать лицо (poker face). Тренируйте выдержку перед зеркалом, отработайте пару «дежурных» выражений и старательно показывайте их в процессе игры. При этом следует участвовать в общем веселье, не стесняться улыбаться и шутить, усыпляя внимание других игроков.

Полезным навыком станет умение ловко и незаметно смещать карты. Стоит отработать раздачу и перемешивание колоды до автоматизма. Необходимо тренироваться легко и незаметно убирать одну карту точно за рубашку другой. Тренированная память очень пригодится при запоминании отбоя. Знание выбывших карт поможет угадать расклад на руках соперника. Стоит внимательно изучить правила различных видов игры в «Дурака»: обычный, подкидной и переводной. В нужный момент можно подловить других участников на незнании правил и повернуть ситуацию в свою сторону.

Как мухлевать в картах в «Дурака» лучше всего

Если в игре принимают участие 4 игрока, в пару лучше выбирать харизматичного и веселого человека. Остроумная перепалка отлично отвлечет внимание от манипуляций с картами. Садиться за игральный стол нужно напротив самого сильного игрока, тогда его старания будут направлены на соседей.

Если «честные» способы не помогают поймать победу за хвост, стоит попробовать обман. Можно мухлевать в «Дурака», как делают дети — просто и бесхитростно подсматривая карты. Более смелый шаг — подыграть себе при раздаче карт. То есть попробовать перетасовать нижнюю видимую карту с верхними таким образом, чтобы потом раздать себе.

Игрок с ловкими руками может незаметно сбросить в отбой «лишнюю» карту. Если игра идет активно и весело, соперники редко следят за количеством карт на руках друг у друга. Если и это не помогает победить, стоит начать мухлевать в «Дурака», как профессионалы игры в «Покер». Крапленые карты помогут точно знать расклад сил противников и делать правильные ходы. Этот способ потребует предварительной разработки собственной системы знаков, как, например, на рисунке выше. Не стоит шулерить при каждой возможности. Как известно, все тайное когда-нибудь становится явным.

Что делать, если обман раскрыт?

Главный постулат шулера — никогда не признаваться. Даже если поймали за руку или разоблачили, единственно правильная линия поведения — «идти в отказ». Можно строить честные и невинные глазки кота из «Шрека», напускать в голос побольше обиды и негодования.

Самый действенный метод — нападение в ответ. Пойманному на обмане игроку не следует стесняться в безосновательном обвинении соседа. Главное, не перегнуть палку, ведь шутливая перепалка не должна стать безобразной ссорой с взаимными оскорблениями. Игра должна приносить удовольствие и смех, а не разлад в компанию.

Игра в дурака неизменно остается одной из самых популярных карточных игр. В нее играют практически все, независимо от пола, социального статуса и даже возраста. Это хороший способ скоротать время и провести интересно вечер с друзьями. Научиться играть в дурака не сложно. Общие правила довольно просты к пониманию, однако можно попробовать научиться не только делать основные ходы, но и вырабатывать свою стратегию. Благодаря этому можно всегда выигрывать в карты. В любом случае начинайте изучение игры с общих правил.

Общие правила

Играть в дурака могут от 2 до 6 игроков. Обычно в игре используется колода, состоящая из 36 карт. Кто-то один должен раздать каждому игроку по шесть карт. Следующая карта при раздаче открывается и ложится под колоду. Это будет козырь в данной партии. Основная колода должна лежать рубашкой вверх. По мере необходимости из нее игроки будут брать карты. Цель игры состоит в том, чтобы избавиться от карт раньше, чем это сделают другие. Проигравшим считается тот игрок, который останется последним с картами в руках.

Начинает игру и ходит первым тот, у кого находится младший козырь. Вторую и последующие партии начинают ходить «из под дурака», т.е. ходит человек, который находится после того, кто проиграл в предыдущей партии. Ходы делаются по часовой стрелке. Ходить можно как одной, так и несколькими картами одного достоинства, несмотря на их масть. Атакуемый игрок должен побить их, накрыв старшей картой такой же масти. Если подходящей масти нет, то побить карты можно козырем.

Игрок, который ходил, может дополнительно подкидывать карты с тем достоинством, которые уже здесь имеются. В случае, если у отбивающегося и козырей нет, то игрок забирает карты, которыми на него походили. Когда игрок отобьется, ход переходит к нему. Если же он забирает карты, то пропускает ход и в игру вступает следующий игрок. Все, у кого осталось меньше шести карт, должны добрать их из колоды. При этом первым всегда берет тот, кто ходил, а последним тот, кто отбивался.

Виды игры в дурака

Игра в дурака имеет разные виды и варианты. Можно играть в простого, подкидного или переводного дурака. Правила в данном случае будут немного отличаться. Так при игре в подкидного дурака подкидывать карты может не только тот, кто ходил, но и остальные игроки. Если игроков много, то в начале игры можно договориться, будут ли подкидывать все игроки или же только крайние, сидящие по обе стороны от того, на кого был сделан ход.

Если играть в переводного дурака, то здесь человек, на которого будут ходить, может перенаправить свой ход другому игроку, положив карту с таким же достоинством. В остальном же правила остаются неизменными. В любой из этих видов игры в дурака несложно играть. Помимо основных правил, стоит рассмотреть и стратегию игры. Если составить ее правильно, то исход игры всегда будет для вас положительным.

Стратегия и тактика игры

Стратегия игры всегда основана на запоминании карт, а также ведении статистики игры. Кончено, не стоит исключать и теорию вероятности, а также психологию игры. Если рассматривать игру на двоих, то можно рассчитать, что из общего количества карт в колоде будет 9 козырных. У игроков оказывается полтора козыря в среднем на руках. Еще один лежит открытым в колоде. На протяжении всей игры нужно постараться посчитать, сколько козырей уходит и какие карты уже были разыграны. Благодаря этому можно спланировать выигрышные ходы.

Во время игры важно не только запоминать карты, но и определить тактику соперника, чтобы вовремя выработать свою противоположную тактику. Например, правильно будет отбиваться парными картами, чтобы у других игроков не было возможности подкидывать. Также не стоит в начале игры разбрасываться козырями. Лучше сохранить их на завершающий этап.

Концовка игры

Концовка игры может быть различной. Все будет зависеть от вас и вашей тактики. Воспользуйтесь некоторыми рекомендациями, чтобы концовка игры была выгодной для вас.

- Помочь выиграть могут парные карты. Если у вас имеются парные карты высоким номиналом под конец игры, значит вам повезло. Они хорошо помогают при нападении, ведь отбить высокие карты сложнее, и при обороне. Пускать их нужно вовремя;

- Старайтесь выбивать козыри противника. В случае, если у вас не будет крупных козырей, то не держитесь и за маленькие. Если их у вас достаточно, то можете бросать их в атаке. Противнику придется отбиваться более крупными козырями, что будет вам на руку. В конце игры противник может оказаться без козырей, а вы выиграть;

- Если в игре вы будете знать карты противника, и вы уверены, что они не парные, можете играть спокойно. Для этого нужно запоминать, какие из них уже вышли. В конце игры вы сможете уверенно занимать господствующее положение.

На самом деле играть в дурака не сложно. Уже после нескольких партий вы сможете разобраться и играть весьма неплохо. Если вы будете играть в компании друзей, они смогут более наглядно показать вам, как нужно действовать. На практике это осваивается быстрее.

Каждому известна игра на картах «Дурак», да и каждый, наверное, играл. В нее играют ради развлечения без знания правил. Для других это способ «заработать».

Много кто видел или играл в карты, но мало кто знает общепринятые правила, способы, разновидности игра, стратегии и другое. Давайте, разберемся, что к чему?

Основные правила:

- Играют в карты колодами в 36 или 52 карты.

- Играют в основном от 2 до 6 человек.

- Колода тусуется, и каждому выдается по 6 карт. После под всю стопку ложится первая карта, которая лежит рубашкой вверх после раздачи.

- Первый ходит, тот, у кого самый малый номиналом козырь.

Противник отбивает карту. К отбитой карте подкидывают карты любой масти, но тем же номиналом, имеющихся карт на столе. Если он не может отбить, то берет. В игре только один проигравший, тот у кого на руках остались карты.

После окончания партии колода опять тусуется. Колоду тасует выигравший вперед всех. В последующих раздачах ходят на дурака.

Для игры нужно знать масти. В колоде 4 масти: черви, крести, бубны и треф.

В обычной колоде в 36 карт: туз, король, дама, валет и карты номиналом от 6 до 10. А в колоде в 52 карты, в отличие от предыдущей колоды, добавляются некоторые карты: джокер белой и черной масти, карты номиналом 2-5. В этой колоде самая сильная карта джокер. Джокер может стать любой картой из мастей белых или черных. Белые — красные масти. Для игры подходят обе колоды карт.

История игрыТочно неизвестно, когда появилась эта игра, но уже два века она точно пережила. Упоминания были у Салтыкова-Щедрина. Игра была популярна больше у крестьян. А после революции 1917 года игра «Дурак» стала популярна у русскоязычных народов.

Разновидности «Дурака». Самая распространенная игра, как и для развлечения, так и для заработка.

Известны несколько разновидностей игры:

- Простой.

- Подкидной.

- Японский.

- Переводной.

Каждые варианта похожи, но присутствуют некоторые расхождения в правилах. Простой «Дурак» описывался выше, так что идем дальше.

В подкидном, отбивающему требуется отбить ход нападающего и остальных игроков. Когда у нападающего нет карт того же номинала, что на столе, то остальные выкидывают карты и отбивают.

В японском козырь — карта бубновой масти. В начале игры каждый игрок берет карту, пока не появится бубновая. В игре ходит игрок с наименьшим козырем. В случаи если нет козырей, то методом жеребьевки, выбирается первый игрок, который делает ход. После первой партии два варианта хода: под дурака, когда ходит игрок, сидящий справой стороны от дурака, или из-под дурака, когда ходит игрок слева.

Про игру «Дурак» — это то, вам стоит знать для умения играть.

Еще одна карточная игра. В эту игру играют в одиночку – пасьянс.

Задача любого расклада пасьянса заключается в том, чтобы разложить карты по стопкам или в одну стопку.

Некоторые виды пасьянсов:

«Аккордеон». Этот вид пасьянса пришел к нам из 19 века. В то время не было телевизоров и интернета, и знатные особы развлекались именно этим видом карточной игры.

Хоть пасьянс – подвид карточной игры, и сам «Аккордеон» тоже подвид. У него есть разновидности:

Классический

«Осажденный замок»

«Бизли»

«Паук». В «Пауке» надо разложить всё, определенной масти в правильной последовательности.

Игра может быть с одной мастью, чаще всего пиковая. В раскладе участвуют 104 карты.

Две масти – 104 карты двух мастей.

Все масти. Количество не меняется, но участвуют в раскладе карты всех мастей.

«Косынка». «Косынка» не имеет разновидностей. Главная задача в игре разложить всё по мастям от туза до короля.

Вариантов карточных игр очень много. Для того чтобы уметь играть в них, нужно знать основные азы и практиковаться. Практиковать навык игры можно с друзьями, но не за деньги. Можно с семьей.

Лучше играть в такие игры только лишь для развлечения. В азартных играх главное вовремя остановиться, а то можно проиграть все.

Дурак — это пожалуй наиболее распространенная разновидность карточных игр, для победы в которой нужно придерживаться определенной тактики и изменять ее в зависимости от действий противника. Есть несколько тактических хитростей, воспользовавшись которыми вы увеличите свои шансы на победу, когда будете играть в дурака онлайн с одним или несколькими соперниками.

Старайтесь не принимать большое количество карт, особенно когда игра приближается к завершению. Не стоит зажимать козыри, иначе вы так и останетесь с ними, когда все соперники уже выйдут из игры. Прежде всего нужно избавиться от мелких карт и оставить крупные. Ходить лучше парными картами, например, если у вас две 8 и одна 10, то ходить лучше восьмерками. В этом случае противнику будет сложнее отбиться, ведь вероятно у него не найдется одной масти и он использует козырь. На протяжении всей игры старайтесь следить за перемещением козырей. Следите за тем, какие уже ушли в отбой, а какие есть в распоряжении соперников. Это вас еще спасет ближе к концу игры, когда, как правило. остаются только самые сильные карты. Также пользуйтесь методом исключения: если к концу игры у вас есть козырный валет, дама и король, то означает туз — самая большая картка, досталась сопернику.

Когда вы отбиваетесь, старайтесь использовать для этого парные карты. Например, если на вас пошли тремя валетами, то будет гораздо выгодней отбиться тремя тузами, чем дамой, королем и одним тузом. В последнем случае будет выше вероятность того, что вам подкинут еще карты, которые вы уже не сможете отбить. Играйте уверенно и немного дерзко, даже если у вас слабый расклад не показывайте этого сопернику. Не стоит беречь до финала пару средних козырей, при этом на протяжении всей игры загребая карты одну за другой.

- Запоминайте карты, принимаемые соперником и когда ходите в следующий раз помните о том, чем он может отбиться;

- Учитывайте, что чем дольше вы не берете карты из колоды, тем выше вероятность того, что все козыри попадут в распоряжение противника. В связи с этим старайтесь не принимать карты, жалея имеющиеся козыря и крупные карты. Это проигрышная стратегия, из-за которой и проигрывает большинство игроков. В результате к концу игры к вам перейдут едва ли не все карты соперника, а у него останутся одни козыря, против которых вам будет нечего поставить.

В этой статье я расскажу о том, как играть в дурака . А именно, опишу методику «как выиграть в дурака ».

Вначале дам краткое представление о том, зачем я пишу эту статью и кто я такой, чтобы давать советы.

Иногда я поигрываю в карты, в переводного, но чаще в подкидного дурака на мейле. Несколько тысяч сыгранных партий и больше половины побед. Последнее время мне начало фартить. Я подумал, а удача ли это или результат многолетних игр? И решил проанализировать свои действия, что и подтвердилось!

Я разработал для себя практически 100% формулу победы ! Теперь я знаю «как выиграть в дурака ». Оказывается, не я один этим интересуюсь. Если вы играете на деньги, вам особенно это поможет! Данная авторская методика относится к игре «подкидной дурак » и применяется с равным успехом как в оффлайне, так и в Интернете.

Итак, приступим. Начнём по порядку. Играть ли с одними и теми же или нет? Ну, ответ очевиден: если везёт, то да. Если нет, значит, нет. Бывает что, играя по методике, иногда проигрываешь, но редко. Это всего лишь исключение из правил, что подтверждает правило, ведь везде есть исключения и погрешности. Имейте это ввиду. Играть можно вдвоём, втроём и вчетвером.

Если играете вдовем – это для кого-то проще, для кого-то нет. Тут есть особые моменты, поддавки — чтобы противник думал, что вы слабы, а вы в самый подходящий момент выкладываете козыри на стол. Главное не пропустить этот момент, дабы не было слишком поздно. Иногда противник хочет раздавить вас до конца, иногда его целью является – проверка вашего терпения, а иногда и выиграть и смыться, оставив вас в лузерах. Гните свою палку и не отступайте от методики никогда : он будет думать, что вы беспорядочно играете, но мы то с вами знаем, что вы следуете правилам, своим правилам.

При игре втроём – выберите на чьей вы стороне, кто вы — атакующий или обороняющийся. Временный союзник это почувствует и подыграет, но помните, в финале – нет союзников — каждый сам за себя и ждите подставы и ответьте с умом, а лучше бейте первым.

Когда четыре игрока – игра только в паре, иначе практически нереально выиграть, хотя случаев масса, когда один побеждает всех. Здесь главное полагаться на доверие партнёра, показав ему своё доверие, подкинув сопернику козырную, таким образом, огородив партнёра от нападения. Он последует вашему примеру.

Это были общие советы, а теперь перейдём к некоторым хитростям. Если вы ходите первыми, и уж тем более у вас туз на руках козырный, то половина дела сделана. Ходите всегда с меньшей карты, особенно если они парные или того больше. Так больше шансов завалить противника, подкидывая больше карт. Если ходят на вас — отбивайтесь крупными, так меньше шансов, что подкинут (в начале игры мало у кого крупняк на руках) или специально собирайте больше крупных карт, чтобы остальные остались ни с чем в конце игры. Так же отбивайтесь картой того же достоинства, но козырной.

Золотое правило , и самое главное правило этой статьи, всей игры в целом и вообще всех карточных игр – умейте считать карты, какие выбыли, а какие нет. Так вы сможете практически с точностью телепата или ясновидящего, буквально знать, какая у кого карта, а это лёгкая победа.

Может быть не всё было сказано, но основные моменты прозвучали. Кроме того — никогда не светите козырные карты, даже когда думаете, что отобьётесь. Вам всё равно подкинут, и вы возьмёте. Но так, они хоть не будут знать какие карты у вас на руках.

Специфических моментов много, но данных советов достаточно, чтобы поднять вас на более высокий уровень, отталкиваясь от того, что вы уже умеете выигрывать в дурака. Добавлю, если ваш партнёр при игре вчетвером даёт противнику три карты, и тот берёт, а у вас на руке две парных и одна непарная, которую можно подкинуть — кидайте одну из парных. Например, у вас два короля и валет. Кидать нужно короля. Потому что если он отобьётся в следующий раз одним из королей, которого вы ему подкинули, думая что все карты вышли или остались в колоде, у вас будет для него сюрприз.

Всегда оставляйте козыри на самый последок, это удивит противника. Можно конечно схитрить и играть только в одном кругу людей или переговариваться, посылать друг другу знаки или мухлевать, но это ничто по сравнению с выверенной формулой, которая обернёт любой, даже самый изысканный мухлёж со стороны противника против него же самого, в вашу пользу. Удачных игр!

Станет ли первоапрельская шутка в McDonald’s тревожным звонком для его Sust?

Обновление: 3 апреля представитель McDonald’s Эшли Инлинг прислала нам следующее заявление

: «Мы читаем

эту историю как веселую шутку в День дураков. Многие читатели высмеяли

из них, как и мы. Насколько мы ценим юмор, McDonald’s серьезно относится к

корпоративной ответственности. У нас есть долгая история лидерства в отрасли в

участии сообществ, защите окружающей среды, благополучии животных, разнообразии и возможностях

, и мы работаем с нашими поставщиками, чтобы помочь

улучшить их практику.Каждый год мы выпускаем Отчет о корпоративной ответственности

, который можно найти на сайте www.crmcdonalds.com. Кроме того, McDonald’s собрал около 150 лучших мировых практик

, направленных на повышение экологичности наших ресторанов. Мы планируем поделиться ими с

в ближайшие несколько недель, так что следите за обновлениями. Хотя мы,

, гордимся достигнутыми на сегодняшний день достижениями, мы надеемся, что

будет постоянно улучшаться в этих областях ».

«Сегодня утром компания McDonald’s объявила

о прекращении планов всемирной инициативы по компостированию

после того, как ученые подтвердили, что ни один из продуктов

в меню McDonald’s не может быть компостирован», — гласила главная статья экологического веб-сайта Grist 1 апреля 2010 года.«Макдональдс остановил этот план после того, как ученые из Университета

Калифорния-Беркли обнаружили, что ни один из

пунктов меню Макдональдс не станет компостом в следующие 500

лет».

Из-за обилия первоапрельских историй, опубликованных вчера, кляп Гриста разорвал сферу социальных сетей, как ребенок, съевший Happy Meal. Но почему обманули столько людей?

Отчасти это связано с историей, опубликованной на Grist несколькими неделями ранее, об этой Happy Meal, которую Джоанн Брусо купила и поставила на полку на один год.365 дней спустя, заметил Бруссо, не было ни плесени, ни запаха, ни разложения, которое обычно ассоциируется с едой, лежащей на полке в течение одного года. (McDonald’s оспаривает утверждение Бруссо как городской легенды, что Бруссо весело опровергает). Автор Grist Тайлер Фальк, написавший первоапрельскую историю, был частично вдохновлен популярным экспериментом Брусо. «Это дало представление о том, что еда McDonald’s не разрушает ту тонкую завесу правдоподобия, которая необходима для любой успешной первоапрельской шутки», — говорит Мэри Бруно, исполнительный редактор Grist. Мол »

Лесть? Смеетесь?

Арифф парировал: «Но что ты делаешь с отходами?»

McDonald’s ответила ссылкой на свою страницу экологической ответственности, которую Arieff

счел пренебрежительной.«Они пытаются быть крутыми? дерзкий?» она говорит нам. «Если бы

они нашли время, чтобы ответить людям, они должны были бы ответить

, предлагая конкретные примеры того, что они делали для сокращения отходов. На их сайте

большая часть их усилий кажется в лучшем случае маргинальной ». (Согласно их сайту, у McDonald’s действительно есть компостирование, состоящее из нескольких пилотных программ в

Канаде и Лондоне.)

Обман оказался успешным, потому что в нем использовался любимый подход Гриста, по словам Бруно: используйте шутку, чтобы подчеркнуть суть дела.«Люди по большей части знают, что еда из Макдональдс совершенно не подходит для вас», — говорит она. «Но это что-то говорит, когда можно убедить так много людей, что ни один пункт в их меню не разложится за 500 лет. Еще одно свидетельство того, что люди понимают McDonald’s, — это то, что Майкл Поллан любит называть «веществами пищевого происхождения», или то, что люди невероятно доверчивы ».

В идеале, говорит Бруно, их подколы побудили бы McDonald’s

более открыто обсудить, как именно они подходят к

отходам и питанию.«Он мог бы служить более здоровой пищей и внедрить масштабный план компостирования

, который значительно сократит количество пищевых отходов на

», — говорит она. «Это такой лидер отрасли, что, если это сделает

McDonald’s, все остальные последуют за ним».

Арифф надеется, что обмен мнениями с ее новым другом в Twitter поможет мобилизовать McDonald’s к действию — прямо сейчас. «Устраните любую дезинформацию», — говорит она. «Покажи, что ты делаешь положительного. Сократите отходы, не «исследуйте способы сокращения отходов»! Обратитесь к национальному разговору об ожирении и измените свой продукт! » Несмотря на то, что она была в панике, Арифф говорит, что она действительно узнала одну вещь, зайдя на веб-сайт McDonald’s: «Мне показалось удивительным, что в других странах McDonald’s предлагает гораздо более здоровые варианты — например, побочный заказ из помидоров черри для детей или овощей в Индии — здесь ничего подобного не делают, кроме калорийных чрезмерно заправленных салатов.”

[Grist]

Принятые доклады — NAACL-HLT 2021

Основная конференция

TITA: двухэтапная модель взаимодействия и тематического сопоставления текста

Синву Сунь, Янлин Цуй, Хунъинь Тан, Цюю Чжу, Фучжэн Чжан и Бейхонг Цзинь

Оценка нейронного качества с множественными гипотезами для исправления грамматических ошибок

Чжэнхао Лю, Сяоюань И, Маосун Сунь, Лайнер Ян и Тат-Сенг Чуа

Маскированные условные случайные поля для маркировки последовательностей

Тяньвэнь Вэй, Ци Цзяньвэй, Шэнхуань Хэ и Сунтао Сунь

Посреднические эффекты в исследовании или какие задачи BERT выполняет в первую очередь?

авив слободкин, Лешем Чошен и Омри Абенд

Настройка триггеров с использованием скрытых данных

Эрик Уоллес, Тони Чжао, Ши Фэн и Самир Сингх

Обзор последних подходов к обработке естественного языка в сценариях с низким уровнем ресурсов

Майкл А.Хеддерих, Лукас Ланге, Хайке Адель, Янник Стрётген и Дитрих Клаков

TR-BERT: Dynamic Token Reduction for Acceleration BERT Inference

Deming Ye, Yankai Lin, Yufei Huang и Maosong Sun

Самоконтролируемое контрастное обучение для эффективного прогнозирования удовлетворенности пользователей в диалоговых агентах

Мохаммад Качуее, Хао Юань, Янг-Бум Ким и Сунгджин Ли

Как можно скорее: набор данных китайского обзора для анализа настроений и рейтинговых оценок категорий аспектов

Цзяхао Бу, Лей Рен, Чжэн Шуанг, Ян Ян, Цзинганг Ван, Фучжэн Чжан и Вэй Ву

RTFE: рекурсивная структура встраивания темпоральных фактов для завершения временного графа знаний

Юри Сюй, Хайхун Э, Мейна Сон, песня вэнью, Сяодун Львов, Ван Хаотянь и Ян Цзиньжуй

Анализ на основе супертэгов с линейными системами перезаписи без контекста

Томас Рупрехт и Рихард Мербиц

О переносимости минимального прогноза с сохранением входных данных при ответе на вопросы

Шейн Лонгпре, Йи Лу и Крис Дюбуа

Интеграция лексической информации в представления окружения сущностей для прогнозирования отношений

Ян Вуд, Марк Джонсон и Стивен Ван

SGG: Обучение выбору, руководству и генерации для генерации ключевых фраз

Цзин Чжао, Цзюньвэй Бао, Ифань Ван, Ючжэн Ву, Сяодун Хэ и Боуэн Чжоу

Предварительная подготовка к многоязычному мультимодальному обучению для Zero-Shot кросс-языковой передачи моделей зрения и языка

По-Яо Хуанг, Мандела Патрик, Джунджи Ху, Грэм Нойбиг, Флориан Метце и Александр Хауптманн

Почти бесплатный семантический проект для нейронного машинного перевода

Си Ай и Бин Фанг

Шумная дистилляция самопознания для обобщения текста

Ян Лю, Шэн Шен и Мирелла Лапата

Предварительная подготовка с метаобучением для сегментации китайских слов

Чжэнь Кэ, Лян Ши, Сунтао Сунь, Эрли Мэн, Бин Ван и Сипенг Цю

Неявно оскорбительная лексика — как это на самом деле выглядит и почему мы не доходим до этого?

Михаэль Виганд, Йозеф Руппенхофер и Элизабет Эдер

KILT: эталон для интенсивных языковых задач

Фабио Петрони, Александра Пиктус, Анжела Фан, Патрик Льюис, Маджид Яздани, Никола Де Као, Джеймс Торн, Ясин Джерните, Владимир Карпухин, Жан Маилларде, Василис Плахтос Себастьян Ридель

Обнаружение предубеждений, связанных с концепцией, в ассоциациях «форма-значение»

Тьяго Пиментел, Брайан Рорк, Сорен Вихманн, Райан Коттерелл и Дамиан Блази

StylePTB: эталон композиции для детализированной передачи управляемого текста

Ивэй Лю, Пол Пу Лян, Хай Фам, Эдуард Хови, Варнава Покзос, Руслан Салахутдинов и Луи-Филипп Моренси

GSum: Общая основа для управляемого нейронного абстрактивного обобщения

Цзы-И Доу, Пэнфэй Лю, Хироаки Хаяси, Чжэнбао Цзян и Грэм Нойбиг

Чтение и действие с завязанными глазами: необходимость семантики в текстовых игровых агентах

Шунью Яо, Картик Нарасимхан и Мэтью Хаускнехт

Хирургия нейронной сети: внедрение шаблонов данных в предварительно обученные модели с минимальными побочными эффектами для экземпляров

Чжиюань Чжан, Сюаньчэн Рен, Ци Су, Сюй Сунь и Бинь Хэ

Метрическое обучение на основе знаний для классификации коротких текстов

Дяньбо Суй, Юбо Чен, Бинцзе Мао, Делай Цю, Кан Лю и Цзюнь Чжао

Нелинейный структурный зонд

Дженнифер К.Уайт, Тьяго Пиментель, Наоми Сафра и Райан Коттерелл

Ab Antiquo: нейронная протоязыковая реконструкция

Карло Мелони, Шаули Равфогель и Йоав Голдберг

Blow the Dog Whistle: набор данных для создания, понимания и дешифрования на китайском языке

Канвен Сюй, Ванчуньшу Чжоу, Тао Гэ, Ке Сюй, Джулиан Маколи и Фуру Вэй

EnSidNet: расширенная гибридная сиамско-глубинная сеть для группирования клинических испытаний по путям разработки лекарств

Люсия Пагани

Важен не только размер: малые языковые модели также малоизвестны

Тимо Шик и Хинрих Шютце

APo-VAE: Генерация текста в гиперболическом пространстве

Шуян Дай, Чжэ Гань, Ю Ченг, Чэньян Тао, Лоуренс Карин и Цзинцзин Лю

Самообучение для неконтролируемого нейронного машинного перевода в несбалансированных сценариях обучающих данных

Хайпенг Сун, Руи Ван, Кехай Чен, Масао Утияма, Эйитиро Сумита и Тиеджун Чжао

Переосмысление нарушений в кодировщиках-декодерах для быстрого обучения

Шо Такасэ и Шун Кийоно

Они ответили? Субъективные действия и намерения в разговоре

Элиза Ферракейн, Грег Дарретт, Джуньи Джесси Ли и Катрин Эрк

Генерация нейронных аргументов с управляемым аспектом

Бенджамин Шиллер, Йоханнес Даксенбергер и Ирина Гуревич

Пользовательский текстовый корпус для оценки морфологического анализа и лексической нормализации японского языка

Шохей Хигасияма, Масао Утияма, Таро Ватанабэ и Эйитиро Сумита

Улучшение абстрактного суммирования с нулевым и малым количеством кадров с промежуточной точной настройкой и увеличением данных

Александр Фаббри, Сименг Хан, Хаоюань Ли, Хаоран Ли, Марьян Газвининеджад, Шафик Джоти, Драгомир Радев и Яшар Мехдад

Внешние вычисления с превосходными функциями

Паркер Райли и Дэниел Гилдеа

Об изучении и представлении социального значения в НЛП: социолингвистическая перспектива

Донг Нгуен, Лаура Россил и Джек Грив

Использование многоязычия в неконтролируемом машинном переводе для редких языков

Ксавьер Гарсия, Адитья Сиддхант, Орхан Фират и Анкур Парик

Самообучение улучшает предварительную подготовку к пониманию естественного языка

Цзинфэй Ду, Эдуард Граве, Белиз Гюнель, Вишрав Чаудхари, Онур Челеби, Майкл Аули, Веселин Стоянов и Алексис Конно

Формирование семантической рамки

Чие-Ян Хуанг и Тин-Хао Хуанг

DART: запись структурированных данных в открытом домене для создания текста

Линьонг Нан, Драгомир Радев, Руи Чжан, Амрит Рау, Абхинанд Сивапрасад, Чиачун Сие, Сянгу Тан, Аадит Вьяс, Неха Верма, Пранав Ирвин Кришна, Ян , Джессика Пан, Файаз Рахман, Ахмад Заиди, Мутетия Мутума, Ясин Тарабар, Анкит Гупта, Тао Ю, Йи Черн Тан, Си Виктория Лин, Кайминг Сюн, Ричард Сохер и Назнин Фатема Раджани

На пути к непрерывному обучению многоязычному машинному переводу посредством замены словаря

Ксавье Гарсия, Ноа Констан, Анкур Парих и Орхан Фират

MediaSum: крупномасштабный набор данных интервью для СМИ для подведения итогов диалога

Чэнгуан Чжу, Ян Лю, Цзе Мэй и Майкл Цзэн

Улучшение нейронной модели синтаксического анализа RST с помощью серебряных поддеревьев соглашения

Наоки Кобаяши, Цутому Хирао, Хидетака Камигаито, Манабу Окумура и Масааки Нагата

Кодируют ли состояния RNN абстрактные фонологические процессы?

Миикка Сильфверберг, Фрэнсис Тайерс, Гаррет Николай и Манс Хульден

SOrT-ing VQA Models: контрастное градиентное обучение для повышения согласованности

Самир Дхарур, Пурва Тендулкар, Дхрув Батра, Деви Парикх и Рампрасат Рамасами Сельвараджу

MUSER: Мультимодальное обнаружение стресса с использованием распознавания эмоций в качестве вспомогательной задачи

Ицюнь Яо, Михалис Папакостас, Михай Бурзо, Мохамед Абуэлениен и Рада Михалча

Насколько (не) оптимальна лексика?

Тьяго Пиментел, Ирен Никкаринен, Кайл Маховальд, Райан Коттерелл и Дамиан Блази

Заполнение шаблона генеративными трансформаторами

Синя Ду, Александр Раш и Клэр Карди

Маршрутизатор знаний: изучение распутанных представлений для графов знаний

Шуай Чжан, Си Рао, И Тай и Це Чжан

Повышение фактической согласованности абстрактного обобщения

Чэнгуан Чжу, Уильям Хинторн, Руочэнь Сюй, Цинкай Цзэн, Майкл Цзэн, Сюэдун Хуанг и Мэн Цзян

Культурное и географическое влияние на переводимость слов в изображениях на разных языках

Никзад Хани, Исидора Чара Турни, Мохаммад Садех Расули, Крис Каллисон-Берч и Дерри Танти Виджая

FUDGE: контролируемое создание текста с будущими дискриминаторами

Кевин Янг и Дэн Кляйн

Мета-обучение первого порядка с уменьшенной дисперсией для задач обработки естественного языка

Линсяо Ван, Кевин Хуанг, Тенгью Ма, Цюаньцюань Гу и Цзин Хуанг

Видео-вопрос с ответами фразами через семантические роли

Арка Садху, Кан Чен и Рам Неватия

SPLAT: Совместное предварительное обучение речи и языка для понимания разговорной речи

Ю-Ань Чунг, Ченгуан Чжу и Майкл Цзэн

Структурированное абстрактное обобщение беседы с помощью графов дискурса и действий

Цзяао Чен и Дийи Ян

Извлечение открытых иерархических отношений

Кай Чжан, Юань Яо, Руобин Се, Сюй Хан, Чжиюань Лю, Фен Линь, Лейу Линь и Маосун Сунь

QA-GNN: рассуждения с помощью языковых моделей и графов знаний для ответов на вопросы

Мичихиро Ясунага, Хоню Рен, Антуан Босселут, Перси Лян и Юре Лесковец

SentSim: межъязыковая семантическая оценка машинного перевода

Юрун Сонг, Цзюньчэнь Чжао и Люсия Специа

Насколько низко слишком низко? Одноязычный взгляд на лемматизацию на индийских языках

Кумар Саунак, Кумар Саурав и Пушпак Бхаттачарья

Пересмотр этических последствий краудсорсинговых задач НЛП

Боаз Шмуэли, Ян Фелл, Лун-Вей Ку и Сумья Рэй

OCID-Ref: 3D роботизированный набор данных с внедренным языком для заземления беспорядочной сцены

Ке-Джюн Ван, Юнь-Сюань Лю, Хун-Тин Су, Джен-Вэй Ван, Ю-Сян Ван, Уинстон Сю и Вэнь-Чин Чен

График рассуждений по ширине для многоскачкового ответа на вопросы

Юнцзе Хуанг и Мэн Ян

Моделирование серьезности жалоб в социальных сетях

Мали Джин и Николаос Алетрас

Разложение, объединение и создание: метод формирования китайских определений

Хуа Чжэн, Дамай Дай, Лэй Ли, Тяньюй Лю, Чжифанг Суй, Баобао Чанг и Ян Лю

Обоснованные разъяснения: рецепт краудсорсинга

Лучиана Бенотти и Патрик Блэкберн

Противоречивое увеличение данных для нейронного машинного перевода

Ци Лю, Мэтт Куснер и Фил Блансом

Проверяют ли синтаксические тесты синтаксис? Эксперименты с Jabberwocky Probing

Роуэн Холл Модслей и Райан Коттерелл

RST Синтаксический анализ с нуля

Thanh-Tung Nguyen, Xuan-Phi Nguyen, Shafiq Joty и Xiaoli Li

Многостороннее обучение для встраивания кросс-языковых слов

Хаочжоу Ван, Джеймс Хендерсон и Паола Мерло

На пути к моделированию стиля переводчиков в нейронном машинном переводе

Юэ Ван, Куонг Хоанг и Марчелло Федерико

SPARTA: эффективные ответы на вопросы в открытой области с помощью поиска согласования разреженных трансформаторов

Тяньчэн Чжао, Сяопэн Лу и Кюсонг Ли

Самореклама в твитах Конгресса США

Джун Ван, Келли Цуй и Бей Ю

Оценка влияния иерархического представления дискурса на производительность разрешения кореферентности сущности

Сопан Хосла и Кэролин Роуз

Неконтролируемый многоскачковый вопрос Ответы на вопросы путем создания вопросов

Лянмин Пан, Вэньху Чен, Вэньхань Сюн, Мин-Йен Кан и Уильям Ян Ван

Пример: деонтологическая этика в НЛП

Шримаи Прабхумой, Брендон Болдт, Руслан Салахутдинов и Алан У. Блэк

Оценка качества подписей к изображениям на основе крупномасштабных человеческих оценок

Томер Левинбойм, Ашиш В.Таплиял, Пиюш Шарма и Раду Сорикут

Причинные эффекты языковых свойств

Рейд Прайзант, Даллас Кард, Дэн Джурафски, Виктор Вейч и Дханья Шридхар

О переносимости эффектов смягчения смещения при тонкой настройке языковой модели

Ксисен Цзинь, Франческо Барбьери, Брендан Кеннеди, Аида Мостафазаде Давани, Леонардо Невес и Сян Рен

Многовидовая регуляризация подслов

Синьи Ван, Себастьян Рудер и Грэм Нойбиг

Управляемое упрощение текста с явным перефразированием

Муника Маддела, Фернандо Альва-Манчего и Вэй Сюй

Использование глубоких представлений радиологических отчетов в анализе выживаемости для прогнозирования смертности пациентов от сердечной недостаточности

Хён Ги Ли, Эван Шолле, Эшли Биси, Субхи Аль’Ареф и Ифань Пэн

Декодирование Smart-Start для нейронного машинного перевода

Цзянь Ян, Шумин Ма, Дондун Чжан, Цзюньчэн Ван, Чжоцзюнь Ли и Мин Чжоу

Слабо контролируемый VisualBERT: предварительное обучение представлений видения и языка без параллельных изображений и подписей

Люниан Гарольд Ли, Хаосюань Ю, Чжэкан Ван, Алиреза Зареян, Ших-Фу Чанг и Кай-Вей Чанг

Многозадачность подавляет семантический дрейф и повышает эффективность выборки в коммуникационных играх

Атул Пол Джейкоб, Майк Льюис и Джейкоб Андреас

Смешение кода на Улице Сезам: Рассвет состязательных полиглотов

Самсон Тан и Шафик Джоти

Полу-контролируемая инициализация политики для игр с подсказками языка

Цу-Джуй Фу и Уильям Ян Ван

Зондирование низкой сложности с помощью поиска подсетей

Виктор Сань и Александр Раш

Регуляризация конфиденциальности: совместная оптимизация утилит конфиденциальности в LanguageModels

Фатемехсадат Мирешгаллах, Хусейн Инан, Марчелло Хасегава, Виктор Рюле, Тейлор Берг-Киркпатрик и Роберт Сим

Dynabench: переосмысление бенчмаркинга в NLP

Доу Киела, Макс Бартоло, Исин Ни, Дивьянш Кошик, Аттикус Гейгер, Чжэнсюань Ву, Берти Видген, Груша Прасад, Аманприт Сингх, Жеманийраделтус, Трамприт Сингх, Жжеманийраделуш, Тханди Стенеторп, Робин Джиа, Мохит Бансал, Кристофер Поттс и Адина Уильямс

Утрата языковой сложности в текстовой терапии

Джейсон Вей, Келли Финн, Эмма Темплтон, Талия Уитли и Соруш Восуги

МелБЕРТ: обнаружение метафор посредством контекстуализированного позднего взаимодействия с использованием метафорических теорий идентификации

Минджин Чой, Пак Хису, Сункён Ли, Ынсон Чой, Чунхёк Ли, Донгвон Ли и Чонвук Ли

Проверка переводов слов в преобразователе и торговом декодере для слоев кодировщика

Хунфэй Сюй, Йозеф ван Генабит, Цюхуэй Лю и Дейи Сюн

Самоконтролируемое тестовое обучение для понимания прочитанного

Пратьяй Банерджи, Теджас Гокхале и Читта Барал

InfoXLM: Информационно-теоретическая основа для предварительного обучения кросс-языковой языковой модели

Зевен Чи, Ли Донг, Фуру Вэй, Нан Ян, Сакшам Сингхал, Венхуэй Ван, Ся Сун, Сянлин Мао, Хэйан Хуанг и Мин Чжоу

Важность моделирования социальных факторов языка: теория и практика

Дирк Хови и Дийи Ян

Сеть скользящего переключателя с динамической памятью для извлечения обобщения длинных документов

Peng Cui and Le Hu

Обучение организации пакета слов в предложения с помощью нейронных сетей: эмпирическое исследование

Чунъян Тао, Шен Гао, Джунтао Ли, Янсун Фэн, Дунъянь Чжао и Жуй Янь

Модель сокращения и расширения для адаптации предметной области нейронного машинного перевода

Шухао Гу, Ян Фэн и Ваннинг Се

Извлечение и передача, ваш BERT уязвим!

Сюаньли Хэ, Линцзюань Лю, Личао Сунь и Цюнкай Сюй

Гетерогенные графические нейронные сети для изучения концептуальных предварительных соотношений в образовательных данных

Чэнхао Цзя, Юнлян Шен, Йечун Тан, Лу Сун и Веймин Лу

KPQA: метрика для генеративного ответа на вопрос с использованием весов ключевых фраз

Хванхи Ли, Сынхён Юн, Франк Дернонкур, Ду Сун Ким, Чунг Буи, Чжунбо Шин и Кёмин Джунг

Сложность слов в глазах смотрящего

Сиан Гудинг, Екатерина Кочмар, Сеид Мухие Йимам и Крис Биманн

Сеть отслеживания контекста: моделирование контекста на основе графа для неявного распознавания дискурсивных отношений

Инсюэ Чжан, Фандун Мэн, Пэн Ли, Пин Цзянь и Цзе Чжоу

DA-Transformer: преобразователь с дистанционным управлением

Chuhan Wu, Fangzhao Wu и Yongfeng Huang

Обнаружение масштабируемых и интерпретируемых семантических изменений

Сириэль Монтариоль, Матей Мартинч и Лидия Пивоварова

Активное обучение $ ^ 2 $: активное сокращение избыточности в методах активного обучения для маркировки последовательностей и машинного перевода

Риши Хазра, Параг Дутта, Шубхам Гупта, Мохаммед Абдул Каасир и Амбедкар Дуккипати

Двойное возмущение: об устойчивости устойчивости и оценке контрфактического смещения

Чун Чжан, Цзею Чжао, Хуан Чжан, Кай-Вей Чанг и Чо-Джуй Се

MM-AVS: полномасштабный набор данных для мультимодального суммирования

Сиянь Фу, Цзюнь Ван и Чжэнлу Ян

UniDrop: простой, но эффективный метод улучшения трансформатора без дополнительных затрат

Zhen Wu, Lijun Wu, Qi Meng, Yingce Xia, Shufang Xie, Tao QIN, Xinyu Dai и Tie-Yan Liu

XOR QA: кросс-языковой открытый поиск ответов на вопросы

Акари Асаи, Джунго Касаи, Джонатан Кларк, Кентон Ли, Юнсол Чой и Ханнане Хаджиширзи

Создание оптимального плана вопросов для интервью с использованием графа знаний и целочисленного линейного программирования

Сохам Датта, Прабир Маллик, Сангамешвар Патил, Индраджит Бхаттачарья и Гириш Палшикар

Автоматическое создание наборов контрастности из графов сцены: проверка композиционной согласованности GQA

Йонатан Биттон, Габриэль Становски, Рой Шварц и Майкл Эльхадад

Классификация языка ненависти на протяжении всей жизни в социальных сетях

Цзин Цянь, Хун Ван, Май Эль Шериф и Сифэн Ян

Построение таксономий на основе предварительно обученных языковых моделей

Кэтрин Чен, Кевин Линь и Дэн Кляйн

Включение синтаксиса и семантики в разрешение Coreference с помощью сети внимания гетерогенного графа

Фан Цзян и Тревор Кон

Фильтрация данных с использованием кросс-языковых вложений слов

Кристиан Герольд, Ян Розендаль, Йорис Ванвинкенрой и Герман Ней

Исследование контекстных языковых моделей для поиска точек соприкосновения с визуальными представлениями

Габриэль Ильхарко, Роуэн Зеллерс, Али Фархади и Ханнане Хаджиширзи

Открытый вопрос, ответы на вопросы по таблицам с помощью плотного извлечения

Джонатан Херциг, Томас Мюллер, Сирин Кричене и Джулиан Эйзеншлос

WEC: Получение крупномасштабного кросс-документационного набора данных Event Coreference из Википедии

Алон Эйрев, Ари Каттан и Идо Даган

Представление событий с последовательными полууправляемыми дискретными переменными

Мехди Резаи и Фрэнсис Ферраро

Обратный перевод повышает доверие пользователей к MT, а не к качеству

Вилем Зоухар, Михал Новак, Ондржей Бояр, Матео Обрегон, Робин Л.Хилл, Фредерик Блен, Марина Фомичева, Люсия Специя и Лиза Янковская

Кратковременная классификация текста с триплетными сетями, расширением данных и обучением по учебной программе

Джейсон Вэй, Чэнью Хуанг, Соруш Восуги, Ю Ченг и Шики Сюй

AdaptSum: на пути к адаптации доменов с низким уровнем ресурсов для абстрактного обобщения

Тиеженг Ю, Зихан Лю и Паскаль Фунг

Тегирование в более широком контексте: когда и почему это работает?

Цзиньлань Фу, Лянцзин Фэн, Ци Чжан, Сюаньцзин Хуанг и Пэнфэй Лю

Создание синтетического корпуса на основе графа знаний для модели языка с расширенными знаниями Предварительное обучение

Ошин Агарвал, Хеминг Ге, Сиамак Шакери и Рами Аль-Рфу

Сегментация нейронной последовательности как определение крайних левых сегментов

Янмин Ли, Лемао Лю и Кайшэн Яо

Дифференцируемое открытое здравое рассуждение

Билл Ючэн Линь, Гаитян Сан, Бхуван Дхингра, Манзил Захир, Сян Рен и Уильям Коэн

Мета-обучение для обобщения предметной области при семантическом анализе

Бейлин Ван, Мирелла Лапата и Иван Титов

Адаптируемая и интерпретируемая нейронная память над символическими знаниями

Пэт Верга, Гаитян Сан, Ливио Бальдини Соарес и Уильям Коэн

МЕЧ: улучшение охвата данных и качества для лексической замены